[mise à jour 7 août 2014]

Un des problèmes majeurs des débats actuels sur la qualité du son des fichiers numériques (soneils) est qu’il est (très) complexe et que le discours communication ou marketing doit, lui, être simple voire parfois simplet pour être compris. D’où un nombre d’approximations et parfois d’erreurs importantes (voir par exemple mon article sur le Bu-ray Pure Audio). En 2014, il aura été beaucoup question du Pono, système créé par Neil Young, qui est un nouvel arrivant sur ce secteur. La partie visible du système Pono c’est le PonoPlayer : un lecteur de fichier numérique audio – dans de nombreux formats – le PonoMusic Store qui vendra des fichiers certifiés et la PonoMusic App, logiciel qui permettra la gestion de la bibliothèque et la synchronisation des fichiers entre le disque dur et le lecteur. Le site de PonoMusic parle d’éco-système (qui ressemble bigrement à iTunes) sans DRM.

Rapide historique du projet Pono

Voici quelques liens à propos de l’historique du projet.

Conférence D : Dive Into Media organisé par All Things Digital le 31 janvier 2012.

C’est une des premières fois où Neil Young parle de son projet (après la pub). http://allthingsd.com/

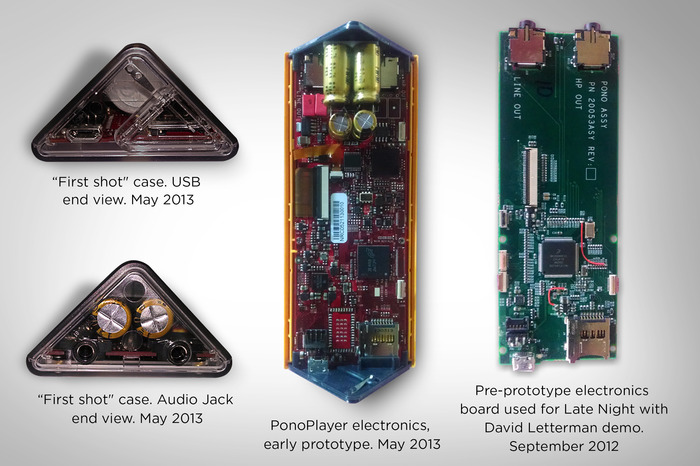

David Letterman Show sur CBS le 27 septembre 2012.

Neil Young présente un prototype du PonoPlayer pour une des premières fois.

En 2014, c’est la levée de fonds en financement participatif (crowdfunding) sur Kickstater qui a fait beaucoup parler du projet.

C’était sans doute l’objectif.

https://www.kickstarter.com/projects/1003614822/ponomusic-where-your-soul-rediscovers-music

Neil Young récolte plein de pognon pour Pono

Article Libération 12 mars 2014 de Sophian Fanen

Le site officiel : http://www.ponomusic.com/

PonoMusic, une initiative parmi d’autres

La démarche de PonoMusic de proposer un son de meilleure qualité que celle du standard de fait format mp3 n’est pas nouvelle. Quelques initiatives existent déjà autour du son qualifié de haute qualité ou haute définition ou haute résolution.

Sur support :

- Pure Audio Blu-ray : Universal, L’éditeur norvégien 2L

- SACD de très nombreux éditeurs

- DVD – HRx : Reference Recordings

- Etc.

En téléchargement et flux (streaming)

Voir à ce propos mon article dans « Musique en bibliothèque » [1]

Le site FindHDMusic essaie de répertorier les différentes initiatives existantes. Il donne en plus une information essentielle (peut être pas toujours à jour) l’importance du catalogue disponible. On note également l’existence pour les plus importants de ces sites de restrictions géographiques.

Voir par exemple l’article 9 des CONDITIONS GENERALES D’UTILISATION ET DE VENTE ABONNEMENT STREAMING QOBUZ

ARTICLE 9 – TERRITOIRE

L’accès aux offres d’abonnement streaming QOBUZ est réservé aux Clients résidant sur les territoires suivants : France, Suisse, Belgique, Luxembourg, Allemagne, Royaume-Uni, Pays-Bas, Autriche et Irlande (ci-après dénommé le Territoire) et disposant d’une carte bancaire émise par un établissement bancaire établi sur le Territoire.

Pareil pour le téléchargement

ARTICLE 6 -TERRITOIRE

Les fichiers musicaux achetés sur le Site sont réservés aux Clients résidant sur les territoires suivant : France, Suisse, Belgique, Luxembourg, Allemagne, Royaume-Uni, Pays-Bas, Autriche et Irlande (ci-après dénommé le Territoire) et disposant d’une carte bancaire émise par un établissement bancaire établi sur le Territoire.

Ce qui se comprend d’un point de vue de la gestion des droits mais qui est totalement incompréhensible pour l’internaute, Internet étant par définition mondial.

Quel argumentaire adopter pour un son HD ?

Voici un extrait du site de Pono Music et de son argumentaire que l’on peut lire dans la FAQ.

La traduction est personnelle, elle vaut ce qu’elle vaut je ne suis professionnel de la traduction.

Pensez vous que Léonard de Vinci serait heureux de ne voir que des photocopies de Mona Lisa ?

L’image est peut être parlante mais elle est totalement fausse. On ne peut comparer un art dit autographique (la peinture ; le tableau c’est à dire l’œuvre est vue par l’amateur sans la présence de l’auteur, l’œuvre ne se déploie pas dans le temps) et un art dit allographique (la musique : l’œuvre musicale est forcément médiée par un ou plusieurs interprètes et la composante temps est fondamentale). De plus, dans le cas de Léonard de Vinci, il est mort depuis bien longtemps et la photocopie n’existait pas. La seule façon de copier à l’époque était qu’un autre peintre fasse une reproduction du tableau donc un procédé analogique, rare et coûteux (économie de la rareté). La situation aujourd’hui est toute différence. La technologie numérique nous permet une reproduction à l’identique (un clone) et en grande quantité (de masse) donc numérique, abondant et bon marché (économie de l’abondance). Dans l’exemple de Léonard de Vinci, on pourrait même envisager non pas une photocopie mais une photo numérique en très haute définition et une impression en 3D pour avoir la matière du tableau. La « reproductibilité technique » est un des thèmes développé par l’école de Francfort, (Adorno, Horkheimer, Benjamin, etc.) et le début de cette réflexion date des années 20 et 30 avant même le numérique. Cette discussion est le centre de ma réflexion autour de l’impact sensitif. Elle doit exister mais elle est ici mal posée. Aujourd’hui dans un studio d’enregistrement (à part de très rares exceptions) tout est enregistré directement en numérique (digital).

La communauté des musiciens se préoccupe beaucoup de leur art. Ils souhaitent que leur musique soit entendue et appréhendée de la façon dont ils l’ont créée dans le studio avec beaucoup d’attention et d’engagement. De nombreuses personnes pensent que les meilleurs disques vinyles capturaient magnifiquement l’essence de leur musique, mais ces formats numériques compressés avec pertes comme le mp3 ne peuvent restituer la totalité de l’expérience émotionnelle musicale qu’ils y mettaient.

Encore un argument étrange, cela sous entend que le mieux serait le vinyle. On ne voit pas, dès lors, quel est l’intérêt de passer par du numérique même de haute définition. Rappelons que le péché originel incontournable du numérique est l’encodage c’est-à-dire la conversion d’un signal ou d’informations analogique (notre monde) en numérique qui est un autre monde qui n’existe pas naturellement. Ce nouveau monde présente d’énormes avantages sinon on n’en parlerait même pas : puissance de calcul et de traitement (tout est quasiment possible) et reproduction à l’infini quasiment à l’identique (clonage). Tout cela au prix d’une conversion/traduction (le péché originel) et on connaît bien l’adage autour de la traduction en littérature : traduire c’est trahir ! Pono est bien obligé de passer par le numérique (et par son péché originel) ce qui entraîne quelque contorsion dans l’argumentaire.

Il y a une autre erreur dans cet argumentaire c‘est de faire croire que le son pressé sur un vinyle serait plus proche de l’expérience sonique vécu par le musicien dans le studio. C’est faux. Une des premières expériences dérangeante que j’ai faite quand j’étais musicien (années 80), c’est justement qu’en analogique on n’a pas du tout le même rendu sur le vinyle que celui du son enregistré sur la bande dans le studio. Et la première fois, je vous assure, c’est très perturbant. Pourquoi ? Parce qu’entre le studio et le disque vinyle, il y a l’opération de masterisation qui apporte des traitements (dont je ne discuterai pas ici) et qui change clairement le son mais qui ne le traduisent pas au sens de conversion numérique. Un bon exemple de cela est la remasterisation (numérique) des disques des Beatles dont j’ai déjà discutée. Cette nouvelle remasterisation de 2009 sur CD conduit à un rendu pour l’auditeur qui est plus proche de ce que les Beatles entendait dans le studio que de ce que le public entendait sur le vinyle d’époque. Pour le dire autrement, on n’a pas du tout sur les CD de 2009 le rendu sonore qu’on avait sur les vinyles des années 60 ce qui peut conduire à des surprises. Dominique Blanc Francard un des plus éminents techniciens son français faisait part de sa surprise à la réédition des albums des Beatles en disant qu’il était admiratif du résultat mais qu’il ne retrouvait pas les sensations qu’il avait eu à l‘époque. [2] Oui, c’est normal, il est impossible d’avoir en écoutant un CD le même rendu que sur un vinyle, ce sont deux mondes distincts.

Nous avons utilisé les enregistrements de qualité studio master (numérique) et nous avons également conçu le lecteur Pono dans une optique « pas de compromis » pour redonner vie à l’enregistrement d’origine.

On voit apparaître ici le mot magique qui semble être le saint Graal de la communication quand on parle de son de qualité : le Master et même le Studio Master. C’est l’argument ultime autour duquel tout semble se cristalliser. C’est aussi l’argument utilisé par Qobuz.

Master, master et re-master

Extrait de l’argumentaire Qobuz

Qu’est-ce donc que la musique en « Studio Master » ?

Il s’agit de fichiers audio d’une qualité rigoureusement identique à celle du studio d’enregistrement où l’œuvre a été captée, mixée et masterisée. Une sorte de prise directe avec les consoles de mixage en quelque sorte.

Qobuz prend l’exemple de l’album « Thriller » de Mickael Jackson.

Je n’y connais rien, ce ne sont que des chiffres, et ça signifie quoi au juste ?

Si on compare avec la vidéo, la « qualité CD » correspondrait à la qualité d’image d’un DVD, et les Studios Masters seraient celle des Blu-ray en Haute Définition, voire celle de l’Ultra Haute Définition / 4K pour certains masters en 24-bit qui vont loin, de l’acabit de l’excellent Thriller de Michael Jackson.

Mauvaise pioche puisque « Thriller » sortie en 1982 est enregistré et mixé entièrement en analogique. « Une sorte de prise directe avec les consoles de mixage en quelque sorte ». C’est totalement faux dans le cas de Thriller. Cela ne signifie pas que les « Studio Master » sont mauvais. Simplement dans le cas de « Thriller », les « Studio Master » numériques n’existent pas. C’est donc qu’une conversion analogique/numérique a été faite beaucoup plus tard. Quand, comment, par qui ? En général, il n’y a aucune information sur ce sujet. C’est le même problème que pour le Blu-ray Pure Audio où Universal met en avant essentiellement des albums des années 60 et 70 donc tous enregistrés en analogique et absolument pas prévus pour une écoute numérique. Lire à ce sujet mon article : Alors, ce Blu-ray Pure Audio ? Par exemple, insister sur la qualité « Studio Master » pour le 1er album du Velvet Underground enregistré sur un magnétophone 4 pistes Ampex et sorti en 1967 en deux versions mono et stéréo est une incongruité pour rester poli.

Les enregistrements actuels enregistrés directement en numérique semblent plus les candidats idéaux à des sorties en « Studio Master ». Attention cependant, dans les années 90 et une partie des années 2000, si enregistrement numérique il y avait, ils ne se faisaient pas en 24 bit mais en 16 bit. Ce qui signifie que pour ces enregistrements, la notion de Studio Masters 24 bit est une pure aberration peut être même encore plus que lorsqu’on repart de la bande analogique.

Pour être un peu complet, il faudrait différencier entre les esthétiques musicales car l’enjeu n’est pas le même pour toutes. Je renvoie à ma série d’articles sur la compression audio dynamique.

Master, mais de quoi parle t-on ?

Et là malheureusement, il faut faire un petit effort pour comprendre de quoi on parle. Qu’est ce qu’un Master, qu’un Studio Master ? L’article L213-1 du Code de la Propriété Intellectuelle défini ce qu’est le producteur de phonogramme :

Le producteur de phonogrammes est la personne, physique ou morale, qui a l’initiative et la responsabilité de la première fixation d’une séquence de son.

Il faut entendre par « producteur de phonogramme » la maison de disques, le label. Cet article est très important car il définit ce qu’est un phonogramme : « fixation d’une séquence de son ». Et même ce qu’est le master : « première fixation d’une séquence de son ». Par définition légale, le producteur est propriétaire du master dont il a financé l’enregistrement. Ce master est légalement définit dans les contrats d’enregistrement.

Bande mère : bande originale permettant la gravure, le pressage le les opérations de production de phonogrammes. (Contrat Virgin des années 80)

Master, bande master : original de l’enregistrement, qui servira de base à la duplication physique ou numérique des œuvres. (Étude Adami)

Avant l’enregistrement numérique (années 80), le résultat du travail dans le studio était une bande magnétique multipistes que l’on mixait en stéréo sur une autre bande magnétique. Cette bande stéréo mixée était unique et c’était le Master, la bande Master, la bande mère. Il était possible de la dupliquer pour des raisons de sécurité mais en analogique chaque reproduction impliquait une perte de qualité (on parle de génération). Elle était donc unique. A partir de cette bande master, il fallait aller dans un studio de masterisation pour créer un flan (lacquer master), un disque unique à partir duquel allaient être créés par galvanoplastie d’abord un père, des mères et enfin les matrices (stampers). Ce sont les matrices qui étaient ensuite utilisées dans les presses pour le pressage des disques vinyles. En analogique, l’étape de masterisation est donc celle qui consiste à copier le son d’une bande magnétique (master) sur un flan disque. C’est une opération essentiellement technique mais on peut y ajouter une touche artistique. Par exemple, c’est en studio de mastering que les Pink Floyd enchaînent à la main et mixent à partir de deux magnétophones stéréo les titres de l’album Dark Side of the Moon en 1973 car les morceaux ne sont pas enchaînés sur les bandes multipistes mais ils s‘enchaînent (pas d’arrêt entre eux) sur le vinyle.

En numérique, cette étape peut être scindée en deux parties :

- La pré-masterisation

- La masterisation.

La masterisation consiste à copier le son à partir d’un support numérique sur un glassmaster et ensuite c’est le même processus que pour le vinyle. C’est une opération quasiment purement technique qui se déroule la plupart du temps directement à l’usine de pressage. Mais copier à partir de quoi et c’est là que les choses se compliquent. Ce quoi étant créé avant la masterisation on devrait appeler cette pré-étape pré-masterisation mais dans le langage courant on l’appelle quand même masterisation (c’est vrai c’est plus simple ;-)). Je l’appellerai pré-masterisation. Elle consiste à créer à partir du master (numérique quelque soit le support) qui sort du studio d’enregistrement un audio master compatible avec la norme Red Book du CD-Audio qui sera la base de la masterisation (le quoi évoqué plus haut). C’est compliqué et je ne rentrerai pas dans les détails mais c’est fondamental. Grâce ou à cause de la puissance des outils numériques cette étape peut être et est souvent aussi une étape artistique. Il est possible de retravailler des fréquences, d’ajouter des réverbérations et surtout c’est là, hélas, qu’on va travailler la dynamique qui conduit à la « loudness war ». Lire mon article : La guerre du volume ou « Loudness war »

Cette longue explication pour poser une question. Où est le « Studio Master » de Pono ou Qobuz là dedans ? Probablement en sortie du studio de pré-masterisation et en général pas en sortie de console comme le dit Qobuz (qui dit aussi que c’est « masterisée », ce qui est contradictoire). Mais ce n’est jamais précisé. C’est pourtant là qu’en définitive se fait la qualité du son que vous entendrez au final chez Pono ou Qobuz.

Intermède

Si vous avez un peu de temps (23 min 48 exactement) je vous conseille très vivement le visionnage de ce remarquable documentaire de 1956 pour RCA beaucoup plus clair que toutes mes explications. En plus il s’agit d’un chef français Charles Munch.

L’étape de masterisation est à 07 :00.

Making vinyl records: The Sound And The Story (1956) en anglais

Cette vidéo est visible sur YouTube mais vous pouvez la télécharger légalement sur archive.org car elle fait partie des archives Prelinger et est dans le domaine public.

https://archive.org/details/Sound_and_the_Story_The

Dans les mêmes archives on trouve Living Stereo – 1958 Vinyl Records Educational Documentary

https://archive.org/details/0122_Living_Stereo_M04234_12_00_41_00

Comment c’est fait ? Un documentaire sur la fabrication des vinyles adapté en français canadien sur un original Discovery Channel.

Masterisation à partir de 3:00

Il manque les étapes entre le flan et les matrices.

http://www.youtube.com/watch?v=lfoghp7AtNw

Deux pages pour en savoir plus sur le pré-mastering numérique

http://mastering-addict.com/le-master-audio/

http://www.sounddesigners.org/articles/th%C3%A9orie/item/13-le-pr%C3%A9-mastering-et-son-anticipation-lors-du-mixage.html

Fin de l’intermède

Retour à Pono

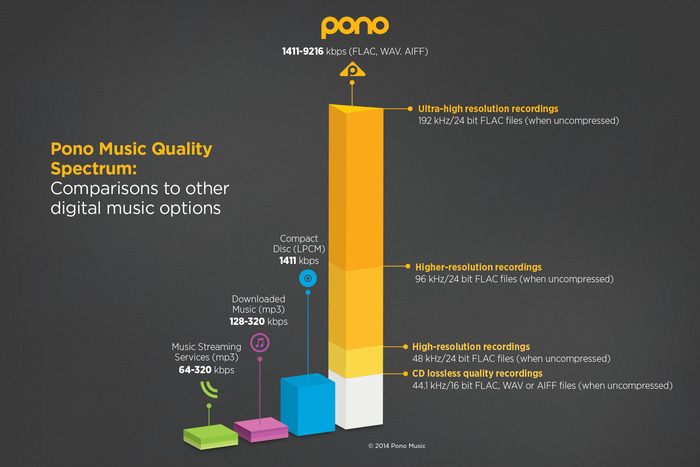

Le site PonoMusic Store proposera 4 qualité de son :

- CD lossless quality recordings: 1411 kbps (44.1 kHz/16 bit) FLAC files

- High-resolution recordings: 2304 kbps (48 kHz/24 bit) FLAC files

- Higher-resolution recordings: 4608 kbps (96 kHz/24 bit) FLAC files

- Ultra-high resolution recordings: 9216 kbps (192 kHz/24 bit) FLAC files

Relevons que proposer quatre qualités dans une démarche « pas de compromis » est un peu contradictoire. Petit rappel technique pour pouvoir comparer. Du format .mp3 à l’Ultra High Resolution de PonoMusic, tous ces formats sont issus d’un encodage PCM (Pulse Code Modulation). C’est également l’encodage qui est utilisé pour le CD-Audio. Cet encodage PCM dans le cas du CD-Audio est qualifié de linéaire par opposition à compressé. L’encodage PCM va être caractérisé par deux chiffres : la fréquence d’échantillonnage exprimée en Hertz (Hz) et la profondeur de quantification exprimée en bit. Ce sont deux chiffres que l’on voit dans les quatre qualités de son de PonoMusic. La fréquence d’échantillonnage a un rapport avec les fréquences (graves, aigues) contenues dans la musique alors que la profondeur de quantification a un rapport avec la dynamique (les nuances, fortissimo, pianissimo).

Pourquoi ce chiffre bizarre de 44, 1 kHz comme fréquence d’échantillonnage ? C’est pour avoir une bande passante (les fréquences) jusqu’à 22 050 Hz la moitié de 44 100 Hz. Rappelons que, dans les livres, il est admis que l’oreille humaine entend les fréquences de 20 Hz à 20 000 Hz pour les plus jeunes. Avec l’âge on perd beaucoup. Autour de 50 ans, on ne doit plus guère dépasser les 10 000 Hz dans les aigues et encore je suis gentil. On comprend alors pourquoi Sony et Philips ont choisi 44,1 kHz de fréquence d’échantillonnage pour la norme du CD-Audio (le Red Book), c’est pour pouvoir enregistrer et donc restituer les fréquences jusqu’à 22,05 kHz donc plus élevé que ce que peut entendre l’oreille humaine (mais pas les chauves-souris qui entendent jusqu’à 100 kHz mais c’est un autre sujet). Du coup, on pourrait se demander à quoi sert-il d’augmenter cette fréquence d’échantillonnage pour enregistrer des fréquences que l’oreille humaine ne peut entendre. Et bien figurez-vous, que c’est un vrai débat et qu’il n’est pas tranché. Récemment une chercheuse au CNRS, titulaire d’un doctorat sur le traitement du signal (en particulier acoustique), me disait qu’elle rendrait son doctorat si on lui démontrait l’intérêt d’une haute fréquence d’échantillonnage, par exemple 192 kHz, c’est-à-dire celle proposée par Pono par rapport au standard du CD-Audio soit 44, 1 kHz. Pour elle, il n’y a pas de différence audible humainement. Donc point d’interrogation. Il n’y a pas consensus sur cette question. C’est donc pour certaines personnes un argument purement marketing dénué de tout fondement scientifique mais je le répète, il n’y a pas consensus sur cette question.

Ce n’est pas la même chose pour la profondeur de quantification. Tout le monde est d’accord. Les 16 bit de la qualité du CD-Audio permettent théoriquement 96 dB (6 dB x 16 bit) de dynamique (rappelons qu’il s’agit de la différence entre les niveaux les plus faibles et les niveaux les plus forts) alors que les 24 bit de Pono et de Qobuz permettent théoriquement 144 dB (6 dB x 24 bit) de dynamique. Et là je vous garantis, cela s’entend. Pour mémoire, rappelons que 120 dB en volume est le seuil de la douleur ! Mais quel est l’intérêt d’avoir 144 dB de dynamique dans des esthétiques qui réduisent fortement la dynamique (compression audio) comme le rock, le rap, les musiques électroniques ? Globalement aucun. C’est différent pour toutes les musiques à base d’instruments acoustiques : classique, partie du jazz et beaucoup de musique du monde.

Il nous reste à parler des formats de compression (informatique pas audio) : mp3, wma, aac, ogg vorbis (ogg est un conteneur), etc. Ce sont tous des encodages PCM et si la conversion se fait à partir d’une source CD-Audio, leurs caractéristiques sont : 44,1 kHz et 16 bit. Ce qui prouve que ces deux chiffres seuls ne nous disent rien de la qualité. Le CD-Audio est PCM, 44,1 kHz et 16 bit. Le mp3 aussi. Mais le CD-Audio est linéaire alors que le mp3 est compressé de façon destructive c’est-à-dire avec perte de données cela se traduit par le débit des informations. C’est une donnée que donne également Pono.

- CD lossless quality recordings: 1411 kbps (44.1 kHz/16 bit) FLAC files

- High-resolution recordings: 2304 kbps (48 kHz/24 bit) FLAC files

- Higher-resolution recordings: 4608 kbps (96 kHz/24 bit) FLAC files

- Ultra-high resolution recordings: 9216 kbps (192 kHz/24 bit) FLAC files

Ce que ne propose pas Pono c’est :

- mp3 lossy quality recordings 128 kbps (44.1 kHz/16 bit) mp3 files

- wma lossy quality recordings 320 kbps (44.1 kHz/16 bit) wma files.

En définitive on s’aperçoit que c’est ce chiffre du débit des informations qui est le plus parlant. C’est bien le discours que tient Neil Young quand il dit : « Avec un mp3 128 kbps on a perdu 95 % des informations ». Il a raison sur le principe, il exagère un petit peu sur les chiffres c’est presque 89 % (100 -1411/128) ce qui est déjà énorme. Pono n’utilise pas de format de compression mais un format de compactage sans perte, le Flac.

Rappelons que le format .wav utilisé par Windows n’est qu’un conteneur et ne dit rien de la qualité, il peut contenir de la haute définition comme du mp3.

Pour conclure, on ne peut pas comparer chiffres à chiffres tout ce qui vient d’être écrit avec le SACD qui est un encodage radicalement différent, le DSD (Direct Stream Digital).

Résumé de tous ces chiffres complexes dans un tableau fourni par Pono et qui est assez parlant.

Le vrai problème est sans doute ailleurs

Comme on vient de le voir, le débat se passe essentiellement autour de chiffres très techniques mais en fait c’est l’expérience de l’écoute, le ressenti de l’auditeur qui sont importants et là c’est un peu (beaucoup) plus compliqué (est ce possible ?). La définition du fichier c’est à dire la qualité technique disponible est un élément mais on s’aperçoit que pour l’auditeur ce n’est pas l’essentiel. Les chiffres, c’est un débat essentiellement autour de l’offre proposée par des prestataires. Qu’en est-il de la demande ? Comme on va le voir, il y a des surprises. Pour le dire autrement, y a-t-il une demande sur des fichiers de haute définition ? Sommes-nous tous capables d’entendre les différences entre fichier compressé et haute définition ? Que préférons-nous si on nous donne le choix ? La majorité des individus écoutant de la musique, on comprendra bien que nous sommes là sur des notions plutôt statistiques. Il existe une partie d’individus que l’on peut qualifier d’audiophiles qui sont très intéressés par l’offre de PonoMusic.

MAIS.

L’expérience MusiClassics 2009

En 2009, le site MusiClassics (qui n’existe plus que sous la forme d’une Appli) faisait une expérience de comparaison de formats de compression en aveugle dans un studio professionnel avec des personnes plutôt averties (voir les conditions et la vidéo). La surprise est dans les résultats du classement de la meilleure qualité entendue à la plus mauvaise :

- WMA 320 kbps

- AAC 320 kbps (ces deux technologies obtenant des notes très proches)

- AAC 192 kbps

- WMA 192 kbps

- Source 1411 kbps

- MP3 320 kbps (loin derrière)

Vous avez bien lu, le fichier qui par définition (objective) était celui de meilleure qualité – puisque fichier source donc l’original – était classé 5e sur 6. Le fichier le mieux classé (subjectivement) était un fichier compressé en WMA 320 kbps. Résultat totalement paradoxal et paraissant aller à l’encontre de toutes les représentations ou idées qu’on se fait sur la question. L’idée qui parait la plus naturelle est que lorsqu’on a un choix entre plusieurs qualités, la majorité des individus vont vers la meilleure qualité. Hé bien, non. Ce qui faisait écrire au journaliste le titre « La compression du son c’est bon pour la musique ». En fait, il faut s’interroger sur comment écoute l‘auditeur, où porte t-il son attention ? Comment son cerveau gère les informations ?

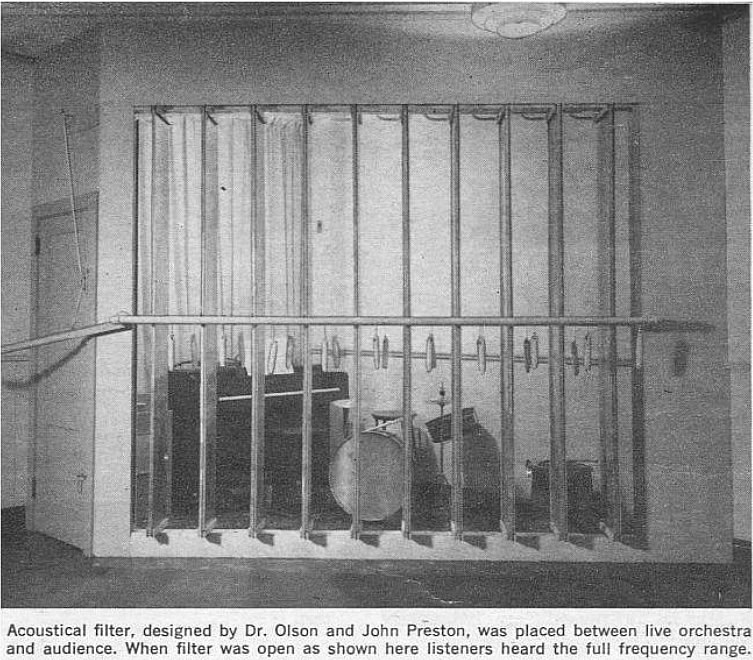

Expérience Olson 1947

Cette expérience de MusiClassics qu’il faudrait très certainement reproduire confirme certains éléments d’une très vieille expérience de 1947 [3] effectuée par un important ingénieur chercheur américain Harry F. Olson qui travaillait chez RCA. Il avait fait jouer un orchestre avec ou sans rideau entre l’orchestre et les auditeurs. Le rideau jouait ici le rôle de filtre acoustique et coupait les fréquences au dessus de 5 000 Hz. 31 % des auditeurs (sur 1 000 sujets) avaient préféré le son filtré. Si cela fait 69 % qui avaient préféré le son qualifié de Hi-Fi (c’est de cette époque que vient le terme). Ce chiffre de 31 % de personnes qui préfèrent délibérément un son que l’on sait de moins bonne qualité acoustique est surprenant.

Expérience Chinn et Eisenberg 1945

Olson essayait d’infirmer une étude de 1945, [4] qui montrait que devant un choix de trois qualités de son radio AM : bande (passante) étroite, bande medium et bande large. La plupart des auditeurs y compris les musiciens professionnels (500 participants) préféraient la bande étroite c’est-à-dire celle de moins bonne qualité sonore.

Ces 3 études ou expériences montrent que contrairement à ce qu’on pourrait croire, lorsqu’ils ont le choix, les auditeurs ne choisissent pas toujours et même rarement la meilleure qualité de son. Pourquoi ? Bizarrement, on n’a pas, aujourd’hui, à ma connaissance, de réponse à cette question. Lorsque je pose cette question en formation, on me répond souvent, « parce que l’oreille s’est habituée à cette qualité ». Je n’y crois pas du tout sinon on serait encore à écouter des cylindres, l’oreille s’y est accoutumée pendant 30 ans. Je tente une hypothèse qu’il faudrait valider par des expériences. Toutes les compressions (informatique ou dynamique) simplifient le signal et en le simplifiant, elles mettent en avant les traits les plus saillants du discours musical qui devient plus lisible. C’est plus facile et moins fatiguant à écouter pour le cerveau. Cela marche très bien sur la mélodie, cela marche très mal sur le timbre. Cela signifie, que certaines musiques vont plus pâtir des compressions que d’autres. Tout ce qui est mélodique va bien s’en sortir : l’écoute est peu perturbée pour l’auditeur, elle peut même être simplifié et donc parfois préférée. Alors que d’autres musiques moins mélodiques – plus portées sur les timbres comme la musique électro-acoustique, la musique spectrale – vont pâtir d’une compression.

Derrière tous ces débats sur la qualité du son, répétons-le, il y a l’idée sous entendue mais jamais exprimée tellement elle paraît aller de soi que si on propose différents choix de qualité, l’auditeur ira « naturellement » vers la meilleure qualité. Cela paraît « naturel » mais c’est faux.

Du coup on est peu loin des préoccupations de Neil Young et de son Pono, il n’est à mon avis pas du tout étonnant de voir que dans les clips de promotions sur KickStater, on ait essentiellement des témoignages de musiciens, de producteurs et d’ingénieurs mais jamais ceux d’un auditeur moyen de base. Neil Young joue beaucoup de sa notoriété pour mettre en avant son système et il a raison mais ce qu’il propose existait déjà sous différentes formes : globalement téléchargement de fichiers audio (soniels) en Haute Définition.

Quelques caractéristiques du système Pono

Pono sera t-il un succès ? Si on entend par succès, une vaste adhésion populaire (statistiquement parlant) alors la réponse est clairement non : Pono ne sera pas un succès.

Pono sera t-il un échec ? Si on entend par échec, un échec financier, ce n’est pas sûr. PonoMusic peut intéresser suffisamment d’amateurs pour être rentable financièrement, mais il s’agira d’une niche comme les sites déjà existant sur ce secteur. Neil Young joue sur sa notoriété et sans doute sur le catalogue disponible (les accords avec les producteurs de phonogrammes).

- Le Pono propose 128 Go de mémoire au total (64 Go en interne avec une carte de 64 Go).

- Obligation de passer par la PonoMusic App pour gérer sa bibliothèque, charger son Pono ou sa carte supplémentaire, synchroniser son ordinateur avec le lecteur. Le site de Pono Music parle bien d’éco system qui ressemble furieusement à iTunes.

- Conséquence, on ne peut pas utiliser le PonoPlayer comme un disque dur externe sans passer par la PonoMusic App.

- Pas de wifi, pas de connexion internet, pas de Cloud pour le PonoPlayer.

- Le lecteur lit des fichiers extérieurs au PonoMusic Store (ouf).

- Pas de DRM (re-ouf).

Tout cela vous parait un peu compliqué ? Oui vous avez raison, çà l’est. Et encore j’ai simplifié et pas tout développé. C’est sans doute la raison pour laquelle ce débat est la plupart du temps mal posé, le sujet n’est en général pas abordé dans toutes ces dimensions et dans toute sa complexité. Qu’on me comprenne bien, je ne dit pas que les offres Qobuz, Pono sont mauvaises. Non, je suis persuadé qu’elles sont de bien meilleure qualité sonore que disons la moyenne mais que malheureusement la majorité des auditeurs ne sont pas capables d’en apprécier les qualités. Une solution ? L’éducation de l’oreille. Raison pour les « médiateurs » de tout poil d’intervenir. Je pense aux bibliothèques, mais aussi les écoles, les conservatoires, les centres de musiques actuelles, etc. C’est une des raisons pour laquelle j’ai mis en place (un peu de publicité) un module de formation sur l’écoute attentive ou profonde.

Que faut-il en retenir de façon synthétique ?

- Que le PonoMusic proposera à une niche d’utilisateurs un son de qualité.

- Que ce ne sera sans doute pas un succès populaire.

- Que ce n’est pas un nouveau format.

- Qu’on ne peut pas améliorer et ajouter des informations là où elles n’existent pas. Dans ce sens PonoPlayer semble se positionner comme une certification de qualité (comme le THX par exemple) d’un bout de la chaîne à l’autre. Le lecteur, si on en croit le discours du site, est composé d’éléments sélectionnés qui devrait faire une différence avec un lecteur lambda.

- Qu’au tout début de la chaîne, ce sont les fichiers sons (soniels) qui vont faire la différence, et comme expliqué plus haut les chiffres ne sont qu’une part de l’histoire et qu’on ne sait rien sur la masterisation. On est obligé de faire confiance à Neil Young.

- Que toutes les initiatives qui proposent du son Haute Définition ne savent pas trop sur quel pied danser quand il s’agit de mettre en place un argumentaire.

- Que l’écoute est un phénomène beaucoup plus complexe qu’on ne le croit.

- Que pour apprécier un son techniquement de haute définition, il faut éduquer l’oreille.

Que tout cela ne nous empêche pas d’écouter de la musique !!!

Notes

[1] ↑ RETTEL Gilles, « L’évolution du paysage de la diffusion musicale », Musique en bibliothèque, Collectif sous la direction de Gilles PIERRET, Electre-Ed. du Cercle de la Librairie, 2012, p. 60-77

[2] ↑ Dominique Blanc-Francard, interviewé dans une enquête sur La musique remastérisée (article de Laurent Rigoulet, Télérama n°3125, page 42)

[3] ↑ Harry F. Olson, Journal of the Acoustical Society of America. July 1947, p 41, »Frequency Range Preference for Speech and Music. »

http://scitation.aip.org/content/asa/journal/jasa/19/4/10.1121/1.1916520

Compte rendu de l’article avec des schémas :

http://ejjamps.com/PDF/experiment-that-saved-high-fidelity.pdf

[4] ↑ Tonal-Range and Sound-Intensity Preferences of Broadcast Listeners Chinn, H.A. et Eisenberg, P. Proceedings of the IEEE. septembre 1945, Page(s): 571 – 581

http://ieeexplore.ieee.org/xpl/articleDetails.jsp?arnumber=1696926&sortType%3Dasc_p_Sequence%26filter%3DAND%28p_IS_Number%3A35751%29